Questo è un articolo sul dodo e sul reverendo T. Bayes, ma il tema non sono né gli uccelli estinti né il calcolo delle probabilità soggettive, bensì le immagini.

Un tacchino tozzo e pesante

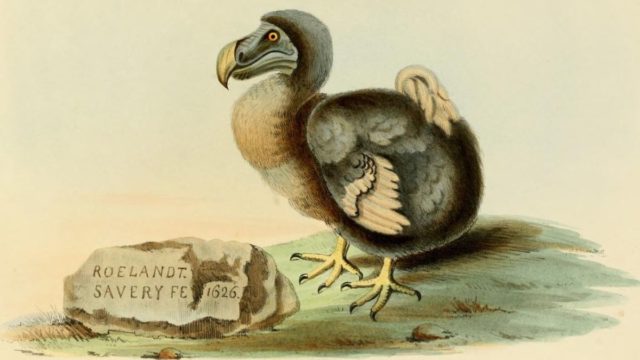

Iniziamo dal dodo, animale solitamente descritto come tozzo e pesante. Coerentemente con le immagini che lo ritraggono – incluse quelle usate per il logo di questo sito (basata su un’illustrazione ottocentesca).

Ebbene: il dodo non era affatto così.

Il fatto è che la maggior parte delle illustrazioni che abbiamo sono state realizzate dopo l’estinzione, avvenuta alla fine del Seicento: non erano ritratti dell’originale ma copie di copie e si sono man mano accentuate le caratteristiche che ci si aspettava da un uccello pacifico, inerme ed estinto.

Alla base di molti di questi ritratti c’è poi il quadro del pittore fiammingo Roelant Savery:

Solo che Savery aveva visto un esemplare tenuto in cattività e probabilmente malato a causa dell’alimentazione a base di carne.

Non credo che in natura avesse l’aspetto atletico di uno struzzo, ma quel collo così ingrossato è probabilmente dovuto a una malattia al fegato.

Ho scoperto tutto questo grazie a un articolo pubblicato su Horizons, la rivista del Fondo nazionale svizzero per la ricerca scientifica, che riprende una tesi di bachelor sulla comunicazione visiva di Oliver Hoop:

Il reverendo T. Bayes

Passiamo adesso al reverendo Thomas Bayes (1701-1761), al quale si deve la formula per calcolare la probabilità di una causa che ha provocato l’evento verificato:

Solo che questa immagine, che troviamo un po’ ovunque incluse molte copertine di libri, non è di Thomas Bayes.

È stata usata in un testo del 1936 con la seguente didascalia: “Rev. T. Bayes: Improver of the Columnar Method developed by Barrett”. Solo che, come spiega Sharon Bertsch McGrayne nel suo saggio The Theory That Would Not Die, il “Columnar Method” è stato sviluppato una cinquantina d’anni dopo la morte di Thomas Bayes. Del resto lo stile del ritratto, in particolare i capelli, non corrispondono. Evidentemente è esistito un altro T. Bayes (che magari si chiamava pure Thaddeus), dimenticato dalla storia ma non dall’iconografia.

Peraltro di Bayes si tende a sbagliare pure la data di morte, avvenuta il 7 aprile del 1761: per un errore di trascrizione alcuni riportano “17 aprile”, mentre altri confondo la data di morte con quella di inumazione, avvenuta il 15 aprile.

La verità delle immagini

Nell’articolo sui dodo, Hoop sottolinea come questo caso “mostra perché le illustrazioni scientifiche debbano essere molto precise”. Certo, per uno scienziato che cerca di ricostruire come viveva il dodo quelle immagini rappresentano un problema in quanto mostrano caratteristiche che gli animali in natura non possedevano. Ma per tutti noi il dodo è così, tozzo e sgraziato, e del resto nella maggioranza dei casi quelle immagini non hanno scopi naturalistici.

Discorso simile per l’immagine di Bayes: solo gli storici della scienza si interessano all’articolo (peraltro postumo) in cui Thomas Bayes parla delle probabilità che una palla rimbalzi da una parte o l’altra di un tavolo.

Le immagini di per sé non sono né vere né false: la verità (o falsità) è una cosa che riguarda non le cose, ma le proposizioni. A essere falsa non è l’immagine di un dodo, ma l’affermare (o il credere) che quell’immagine sia una rappresentazione fedele di un esemplare tipico di un uccello esistito secoli fa.

Di una immagine possiamo al più dire se è più o meno adeguata a una determinata funzione. Il che complica incredibilmente le cose.